av Mikael Winterkvist | mar 14, 2026 | Bluesky, Mastodon, Säkerhet, Threads, Twitter |

En hackergrupp påstår sig ha kommit över stora mängder känslig information genom ett intrång i IT-bolaget CGI:s system. Enligt uppgifter på darknet rör det sig om källkod, lösenord och krypteringsnycklar till en plattform som används för svenska myndigheters digitala tjänster.

CGI bekräftar att en läcka har skett men betonar att incidenten är begränsad till två interna testservrar. Företaget ser inga tecken på att kunders faktiska produktionsmiljöer eller riktiga användardata har påverkats. En äldre version av källkoden till en applikation ska dock ha varit åtkomlig vid intrånget.

Skatteverket tonar ner oron

Skatteverket är en av de myndigheter som använder den drabbade tjänsten, främst för e-signaturer. Trots larmen menar myndighetens IT-direktör, Peder Sjölander, att läget är under kontroll.

-

Ingen användardata: Varken myndighetens eller medborgarnas data ska ha läckt ut.

-

Ingen gemensam plattform: Uppgifterna om att en ”myndighetsgemensam e-plattform” skulle ha drabbats avvisas som felaktiga.

-

Psykologisk krigföring: Sjölander tror att förövarna främst vill skapa otrygghet hos allmänheten.

Säkerhetsåtgärder och framtida risker

Myndigheten för civilt försvar har som en försiktighetsåtgärd stängt ner delar av sin webbplats för externa tjänster. Det görs för att kartlägga om deras system kan ha påverkats av den exponerade källkoden.

Även om ingen skarp data har stulits varnar säkerhetsexperter för de långsiktiga effekterna av att källkod hamnar i fel händer. När angripare får tillgång till själva ritningarna för ett system får de också möjlighet att i lugn och ro leta efter säkerhetshål. Det kan i förlängningen användas för att konstruera mer riktade och effektiva attacker mot de skarpa miljöerna.

Just nu beskrivs händelsen som en ”allvarlig exponering”, men den fulla vidden av skadan beror helt på hur mycket av den läckta koden som fortfarande är relevant för de system som används idag.

Källa: SVT

av Mikael Winterkvist | mar 14, 2026 | Bluesky, Mastodon, Övervakning, Threads, Twitter |

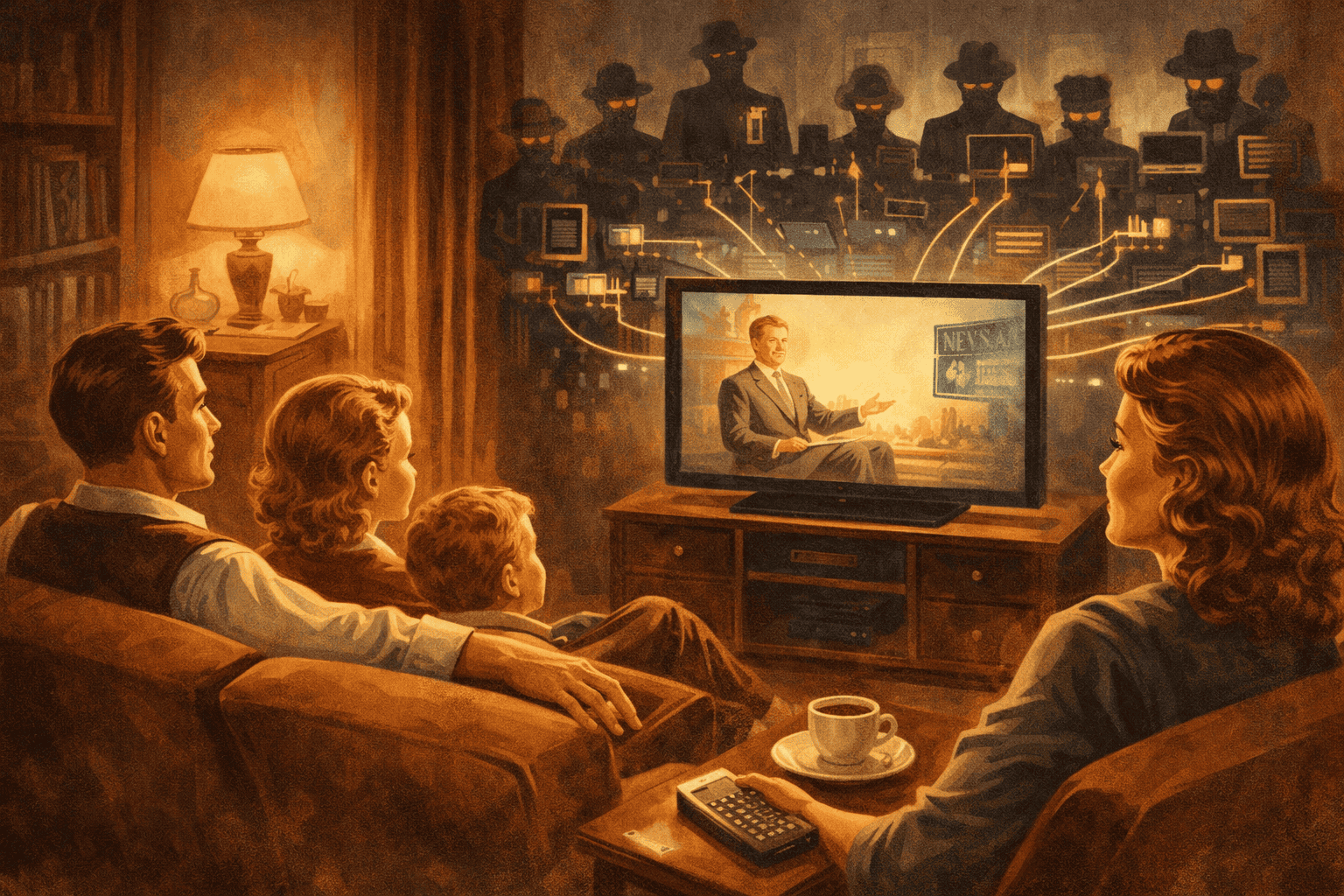

Smarta tv-apparater erbjuder internetanslutning och streaming, men de samlar också in enorma mängder personlig data för att sälja vidare till annonsörer.

Smarta tv-apparater är dessutom alltid är uppkopplade vilket i vart fall i teorin kan innebära att hackare kan utnyttja sårbarheter för att installera skadlig kod, stjäla inloggningsuppgifter eller komma åt inbyggda kameror och mikrofoner. I värsta fall används tv:n som en ingång till din router för att hacka hela ditt smarta hem.

FBI:s rekommendationer för säkerhet

För några år sedan gick FBI ut med en varning om riskerna och konstaterade att tillverkare och apputvecklare har möjlighet att både lyssna och titta på dig. Myndigheten betonar att du inte behöver vara rädd för att använda din tv, men du bör följa dessa riktlinjer:

-

Kartlägg funktionerna: Ta reda på exakt vad din tv kan göra. Sök på modellnumret och ord som ”mikrofon”, ”kamera” och ”integritet” om du saknar manualen.

-

Ändra standardinställningar: Lita inte på fabriksinställningarna. Byt lösenord där det går och lär dig hur du stänger av mikrofoner, kameror och datainsamling. Om det inte går att stänga av bör du överväga om du alls vill använda tjänsten.

-

Fysiska hinder: Om du inte kan stänga av en kamera i mjukvaran fungerar en bit svart eltejp över linsen som ett enkelt och effektivt skydd.

-

Säkerhetsuppdateringar: Kontrollera om tillverkaren faktiskt skickar ut säkerhetsuppdateringar och om de har gjort det historiskt.

-

Granska policyn: Läs integritetspolicyn för både tv-tillverkaren och de streamingtjänster du använder. Kontrollera vilken data de samlar in, var den lagras och vad de gör med den.

Vad experterna säger om hoten

Shane Barney, säkerhetschef på Keeper Security, och John Gallagher från Viakoo Labs förklarar att dagens elektronik har kraftfulla processorer och minne som kan utnyttjas av angripare.

Enligt Gallagher gör dessa processorer det möjligt för hackare att utvinna kryptovaluta (som Monero) eller utföra massiva överbelastningsattacker (DDoS). Den största risken med AI är att video- och ljuddata nu kan bearbetas och användas för skadliga syften mycket mer effektivt än tidigare.

Barney menar att målet sällan är att störa det du tittar på. Det verkliga värdet ligger i att använda tv:n som en väg för att nå bärbara datorer, routrar eller andra anslutna system där känsligare information finns. Ju fler uppkopplade enheter du har, desto större blir den totala risken.

Tillverkarnas egen datainsamling

För de flesta användare är den lagliga datainsamlingen från tillverkarna ett större bekymmer än hacking. Gallagher påpekar att du genom att godkänna användarvillkoren ofta ger tillverkaren rätt att övervaka aktiviteten i ditt hem. Detta kan användas för att kartlägga dina vanor, när hemmet är tomt eller för att skapa hyperrealistiska deepfakes med hjälp av AI.

Ett aktuellt exempel på integritetsproblem är Rings reklamfilm från Super Bowl 2026, där funktionen ”Search Party” kan spåra både hundar och människor utan deras samtycke, vilket visar att integritet fortfarande är en stor fråga.

Automatic Content Recognition (ACR)

ACR är en funktion som analyserar innehållet på din skärm för att rikta annonser. Barney förklarar att det inte är skadligt i sig, men att mängden beteendedata som samlas in och delas vidare i annonssystem är problematisk. Gallagher rekommenderar att du stänger av ACR helt, även om tillverkarna ofta gör dessa menyer svåra att hitta under rubriker som ”visningsdata” eller ”interaktivitet”.

Så skyddar du dig: Du bör närma dig din smarta tv med samma säkerhetstänk som en dator. Se till att programvaran är uppdaterad, granska integritetsinställningarna noga och stäng av allt som inte är nödvändigt – särskilt röststyrning, kameraåtkomst och insamling av visningsdata.

Samsung: Inaktivera ”Viewing Information Services”

Samsung kallar sin ACR-teknik för Viewing Information Services. Det är den funktion som analyserar vad du tittar på i realtid.

Här hittar du inställningen:

-

Tryck på Hem och gå till Inställningar.

-

Välj Allmänt och integritet (General & Privacy) > Villkor och integritet (Terms & Privacy).

-

Öppna Integritetsval (Privacy Choices).

-

Leta upp Viewing Information Services och avmarkera rutan eller slå av brytaren.

-

Passa även på att stänga av Intressebaserad annonsering (Interest-Based Advertising) i samma meny.

LG: Stoppa ”Live Plus”

På en LG-TV med webOS gömmer sig den viktigaste spårningen under namnet Live Plus.

Här hittar du inställningen:

-

Tryck på kugghjulet (Inställningar) på fjärrkontrollen.

-

Gå till Alla inställningar > Allmänt > System.

-

Välj Ytterligare inställningar (Additional Settings).

-

Ställ in Live Plus på Av.

-

Gå även till Annonsering (Advertisement) i samma meny och aktivera Begränsa annonsspårning (Limit AD Tracking).

Sony (Google TV/Android TV): ”Samba Interactive TV”

Sony använder ofta en tredjepartstjänst som heter Samba TV för sin innehållsidentifiering.

Här hittar du inställningen:

-

Tryck på Hem och gå till Inställningar.

-

Välj System eller Enhetsinställningar (Device Preferences).

-

Leta efter Samba Interactive TV.

-

Välj Inaktivera (Disable) för att stoppa tjänsten helt.

-

För att rensa ditt annons-ID: Gå till Inställningar > Integritet > Annonser och välj Nollställ annons-ID.

Philips och övriga med Google TV

För apparater som kör ren Google TV (som nyare Philips och TCL) ligger kontrollerna ofta direkt under ditt Google-konto.

Här hittar du inställningen:

-

Gå till Inställningar via kugghjulet i övre hörnet.

-

Välj Integritet (Privacy).

-

Gå till Användning och diagnostik (Usage & Diagnostics) och stäng av all rapportering.

-

Kontrollera även under Annonser (Ads) att Anpassade annonser är avstängt.

Kom ihåg: Om du inte använder TV:ns inbyggda appar utan istället kör via en Apple TV eller spelkonsol, är det mest effektiva att helt enkelt dra ur nätverkskabeln eller radera Wi-Fi-lösenordet i TV:ns inställningar. Då blir din ”smarta” TV en helt vanlig, säker bildskärm.

Källa: PC-Mag

av Mikael Winterkvist | mar 14, 2026 | Bluesky, Mastodon, Säkerhet, Threads, Twitter |

Hackergruppen ByteToBreach påstår sig ha kommit över extremt känslig källkod och krypteringsnycklar från IT-jätten CGI Sverige. Informationen har publicerats på darknet och rör system som svenska myndigheter, däribland Skatteverket, använder för inloggning med Bank-id.

CGI tonar ner händelsen och uppger att intrånget begränsats till två interna testservrar. IT-säkerhetsexperten André Catry varnar dock för att konsekvenserna kan bli långvariga och allvarliga. Enligt Catry innebär tillgången till källkoden att angripare nu har fått ett ”facit” över hur systemen är uppbyggda.

Fienden har fått ritningarna

När källkoden ligger öppen kan hackare i lugn och ro analysera miljontals rader kod för att hitta sårbarheter. Du får en situation där angripare kan bygga kopior av myndigheternas miljöer hemma och testa olika attacker tills de lyckas.

-

Sårbarheter i koden: Det är nästintill omöjligt att undvika svagheter i så omfattande system, och nu vet angriparna exakt var de finns.

-

Insyn i delkomponenter: Läckan avslöjar hela strukturen av underleverantörer och komponenter, vilket underlättar förberedelser för framtida attacker.

-

Risk för störningar: En attack behöver inte knäcka själva Bank-id för att skada. Det räcker att slå ut kopplingen mellan Bank-id och myndigheten för att stoppa medborgare från att deklarera eller sköta sina ärenden.

Pengar snarare än politik

Trots det allvarliga läget bedömer experter att det inte rör sig om en statlig attack från exempelvis Ryssland. En statlig aktör hade sannolikt analyserat koden i tysthet istället för att publicera den öppet. ByteToBreach beskrivs snarare som en mindre, opportunistisk grupp som dök upp sommaren 2025. Deras främsta drivkraft är ekonomisk vinning genom utpressning och att skapa oro.

Det som har läckt ut beskrivs som ett strategiskt verktyg för framtida angrepp. Även om inget har hänt i de skarpa produktionsmiljöerna ännu, har förövare nu fått de nycklar som krävs för att bygga betydligt mer sofistikerade attacker mot den svenska digitala infrastrukturen.

Källa: Dagens Nyheter

av Mikael Winterkvist | mar 14, 2026 | Artificiell intelligens, Bluesky, Mastodon, Threads, Twitter |

OpenAI lanserade i tisdags en uppsättning interaktiva visuella verktyg i ChatGPT. Användare kan nu manipulera matematiska och vetenskapliga formler i realtid. Denna utbildningssatsning landar mitt i en turbulent period för företaget.

Det nya gränssnittet täcker över 70 centrala koncept, från Pythagoras sats och Ohms lag till ränta-på-ränta-effekten. När en användare ber ChatGPT förklara något av dessa ämnen skapas en dynamisk modul med skjutreglage bredvid textsvaret. Genom att dra i en variabel uppdateras ekvationer, grafer och diagram omedelbart. Funktionen är tillgänglig för alla inloggade användare globalt, inklusive de på gratisplanen.

Höga insatser under krisdrabbat år

Enligt OpenAI använder redan 140 miljoner människor ChatGPT varje vecka för lärande inom matematik och vetenskap. Siffran är svindlande, men lanseringen sker samtidigt som företaget pressas från flera håll. Sedan slutet av februari har OpenAI:

-

Blivit stämda av familjen till ett offer för en masskjutning.

-

Förlorat sin robotikchef efter ett kritiserat Pentagon-avtal som ledde till att avinstallationerna av appen ökade med nästan 300 %.

-

Sett över 30 egna anställda ge juridiskt stöd till konkurrenten Anthropic i en tvist mot amerikanska staten.

-

Skrotat planer på att expandera ett viktigt datacenter i Texas tillsammans med Oracle.

Samtidigt toppar huvudkonkurrenten Claude listorna i App Store. De interaktiva verktygen ses som en stark produkt, men de lanseras i ett läge där företaget kämpar på alla fronter och beräknas göra av med 15 miljarder dollar i likvida medel under året.

Så fungerar de interaktiva modulerna

Funktionen bygger på att förståelsen ökar när elever ser vad som händer när indata ändras. Om du ber om hjälp med Pythagoras sats, $a^2 + b^2 = c^2$, visas en panel med reglage för sidorna $a$ och $b$. En geometrisk visualisering av en rätvinklig triangel omformas dynamiskt medan du justerar värdena. Hypotenusan räknas ut i realtid.

Samma princip gäller för Ohms lag där spänning och resistans kan justeras, eller för den ideala gaslagen där tryck och temperatur påverkar resultatet. OpenAI siktar främst på material för gymnasiet och inledande universitetsstudier. Det inkluderar allt från kinetisk energi och Hooks lag till trigonometriska identiteter och volymberäkningar för cylindrar.

Lärare ser positivt på utvecklingen

Företaget hänvisar till forskning som visar att interaktionsbaserat lärande ger djupare konceptuell förståelse än traditionell undervisning. I tidiga tester uppger föräldrar att de använder modulerna för att lösa problem tillsammans med sina barn.

Anjini Grover, matematiklärare på gymnasienivå, betonar hur starkt funktionen lyfter fram den underliggande logiken. Algebra-läraren Raquel Gibson ser det som ett steg mot att ge elever möjlighet att självständigt utforska abstrakta begrepp. Verktygen bygger vidare på befintliga funktioner som ”studieläge” och provförberedande quiz. OpenAI planerar att expandera satsningen till fler ämnen och studera hur AI påverkar läranderesultat över tid genom initiativet NextGenAI.

av Mikael Winterkvist | mar 14, 2026 | Bluesky, Mastodon, Övervakning, Threads, Twitter

Den här texten bygger på rykten och uppgifter om att Apple jobbar på en AI-produkt som ska bäras utanpå kläderna, försedd med mikrofoner och en kamera.

Apple växlar upp tempot i utvecklingen av bärbar AI. Det handlar om ett smart hängsmycke utrustat med kameror och mikrofoner som ska bäras på utsidan av dina kläder. Enheten är designad för att se det du ser och höra det du hör i realtid. Syftet är att ge Siri den kontext som hittills saknats, men priset för denna bekvämlighet är din och andras personliga sfär.

Integritetsanalysen av ett sådant koncept är mörk. Du bär nu en maskin som konstant registrerar din omgivning, dina samtal och dina sociala interaktioner. Apple har länge profilerat sig på att skydda användardata, men med en kamera runt halsen suddas gränsen mellan privatliv och ständig övervakning ut. Du blir i praktiken en vandrande sensor åt ett av världens största techbolag.

Lägg sedan till att omgivningen avlyssnas och alla kan data samlas. Redan idag så finns det elektroniska produkter som används för att spela in samt al, möten, exempelvis och i Sverige är det förvisso tillåtet men sannolikt så reagerar de flesta över moralen och etiken i att spela in allt som sägs – utan att berätta det innan.

Strategin bakom de här produkterna är tydlig. Genom att placera hårdvaran utanpå kläderna slipper Apple de tekniska begränsningar som finns i en ficka. Du får en AI som kan varna dig för hinder, känna igen ansikten eller sammanfatta möten du precis lämnat.

Algoritm

Frågan är om du verkligen vill leva i en tillvaro där varje blick och varje viskat ord blir till träningsdata för en algoritm?

Detta är inte bara ännu en pryl i ekosystemet. Det är ett steg mot en värld där vi aldrig är helt bortkopplade. Du får visserligen en assistent som förstår din kontext bättre än någonsin, men du förlorar samtidigt rätten att vara osedd. Den sociala acceptansen för att bära en synlig kamera i vardagen kommer att bli Apples största utmaning hittills.

Min gissning är att Apple kommer att se till att allt, alla data lagras lokalt. Apple har en lång tradition av att skydda användarnas och användarnas information. Integritet är inte bara marknadsföring och PR för Apple utan det sitter djupt i företagets DNA.

Jag använder själv en sån här AI-produkt för att spela in möten. Fieldy, hänger runt halsen, spelar in ljudet och omvandlar det till text som sedan kan bearbetas. Det går sekundsnabbt att plocka ut det som sagts som text, plocka ut vilka saker som ska Götas, och vem som ska göra vad. Jag berättar alltid vad den lilla svarta saken runt min hals gör, hur jag använder AI-enheten och om någon som deltar i mötet vill ha all text, en kopia, så går det bra.

För transparensen skull ska också sägas att Fieldy är en av Magasin Macken samarbetspartners.

Glasögon

Glasögon

Uppgifterna om Apples produkt är fortfarande bara rykten men det finns liknande produkter, redan idag. Du kan köpa ett par glasögon, Ray Ban, med en intern skärm och med mikrofoner och kamera som fångar upp din omgivning. Det finns mikrofoner som du bär runt halsen som spelar in allt ljud, både i form av text och som ljudfil.

De här produkterna ingår i helt andra tekniska plattformar och i företag vars grundläggande affärsidé är att smala in och slöja din information. Meta, Facebooks ägare, har sådana här glasögon. Det finns en rad andra leverantörer och ett par glasögon kostar idag under tusenlappen och säljs av de stora teknikkedjorna. Det är med andra ord ingen dyr nischprodukt längre.

Det syns inte utanpå att glasögonen kan användas för att samla in allt i sin omgivning. I takt med att elektronik och batterier har kunnat göras allt mindre så blir glasögonen alltmera diskreta och du kan få AI-glasögon via din optiker så att de har samma styrka och synkorrigeringar som vilka glasögon som helst.

Noterbart är också att i marknadsföringen av alla dessa glasögon så nämns mycket sällan att data samlas in och skickas iväg – din data.

Test av Fieldy – del 1: Så slipper du sitta och anteckna under dina möten

Test av Fieldy – del 2: Dags att installera den nya AI-kompisen

Test av Fieldy – del 3: Anteckningsfunktionen sätts på hårda prov

av Mikael Winterkvist | mar 14, 2026 | Bluesky, Mastodon, Övervakning, Threads, Twitter |

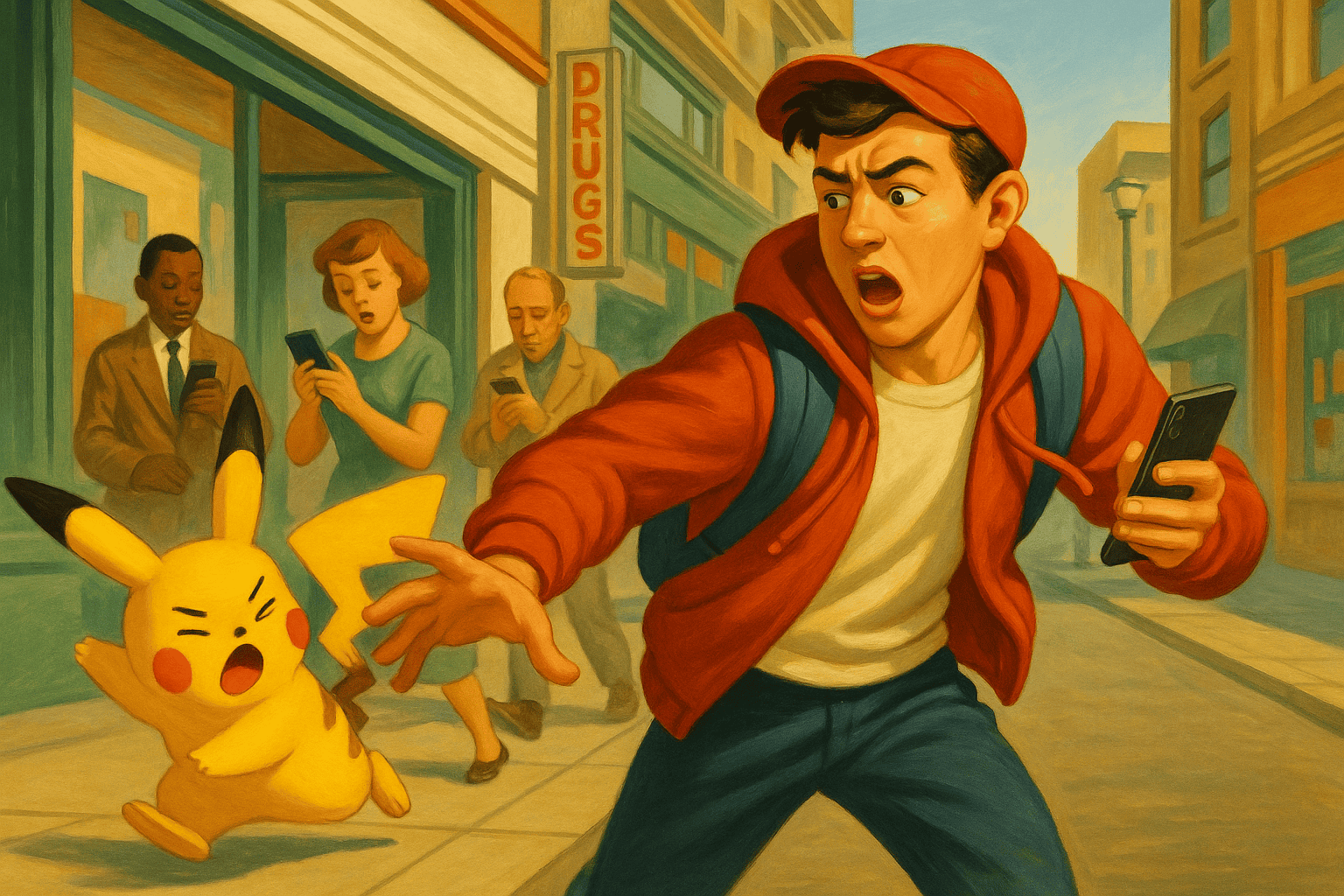

All den tid du lagt på att skanna statyer och landmärken för att fånga virtuella varelser har i tysthet förvandlats till en massiv databas för kommersiell robotik. Det som såg ut som oskyldig underhållning har visat sig vara en gigantisk, gratis arbetsinsats för att träna Niantics navigeringssystem VPS.

Poängen är att insamlingen av data har skett utan att spelarna haft en aning om vad bilderna faktiskt ska användas till. Genom att locka med belöningar i spelet har Niantic fått miljontals människor att utföra det tidskrävande arbetet med att kartlägga världen i 3D – en uppgift som annars hade kostat miljarder att genomföra.

Data som byter skepnad

När du skannade en lokal staty för att klara en ”Field Research”-uppgift, skapade du i själva verket en pusselbit i ett kommersiellt navigeringsverktyg. Denna data säljs nu vidare eller används i samarbeten med företag som Coco Robotics. Det är ett tydligt exempel på hur användargenererat innehåll kan paketeras om och få ett helt nytt syfte långt efter att det samlats in.

Det som började som en digital skattjakt har blivit en grundpelare för logistikbranschen. Du har, utan att veta om det, varit med och byggt det system som gör att budrobotar kan navigera på centimeternivå där GPS går bet.

Från spel till övervakningskapitalism

Detta väcker viktiga frågor om transparens och samtycke. Även om Niantic äger rätten till den data du skapar i appen, var det få spelare som 2020 insåg att deras kameravinklar av en parkbänk sex år senare skulle vara en affärsprodukt för matleveranser.

Processen påminner om andra dolda datainsamlingar:

-

CAPTCHA-tester: Du bevisar att du är människa, men tränar samtidigt Googles AI-modeller för bildigenkänning.

-

Waze: Din positionshistorik blir till värdefull data som kan köpas av myndigheter eller polisen.

-

Pokémon Go: Din jakt på Pikachus blir till detaljerade 3D-kartor för autonoma maskiner.

Samarbetet med Coco Robotics är bara början. När robotarna börjar rulla på gatorna kommer de i sin tur att samla in ännu mer data för att uppdatera kartan. Den lekfulla ytan i Pokémon Go har visat sig vara ett effektivt sätt att få användare att frivilligt och ovetandes bygga upp ett omfattande kommersiellt övervaknings- och navigationsnätverk.

Källa: Popular Science